[国道 5 号線 (創成川通り) にらむ洗濯機]

はい,

こいつの重量は 20 kg 弱だったんだけど,

じつに持ちにくくてすごく苦闘した.

この状態からだと「背中にかつぐ」というワザが使えたんだけどね

(すると 50 m ぐらいいっきに運べる).

再商品化料金 2520 円 + 収集・運搬料金 2100 円

(これは店からリサイクルセンターへの輸送費も含まれる),

合計 4620 円しはらって 1410 帰宅.

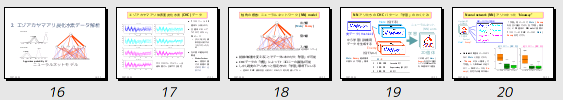

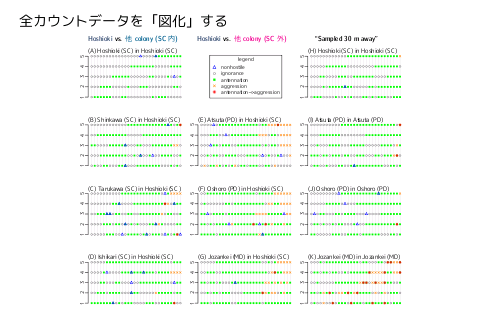

glm.nb()

とかでケリをつけたらいい問題だ.

で,

やったらたぶん distance の影響なんてそんなに大きくない,

と推定されるんではないかな.

分詞構文のなかには、意味上の主語が主文の主語と異なるのに、意味上の主語をつけないで慣用的に使用される分詞構文があります。これを非人称独立分詞構文と言います。で, てもとの高校生むけ敵国語文法書をよくみなおしてみたら, ちゃんと「独立分詞構文の例外」「慣用的な分詞構文」 として説明されてた. うう

judging from 〜, considering 〜, given 〜 などがこれにあたります。

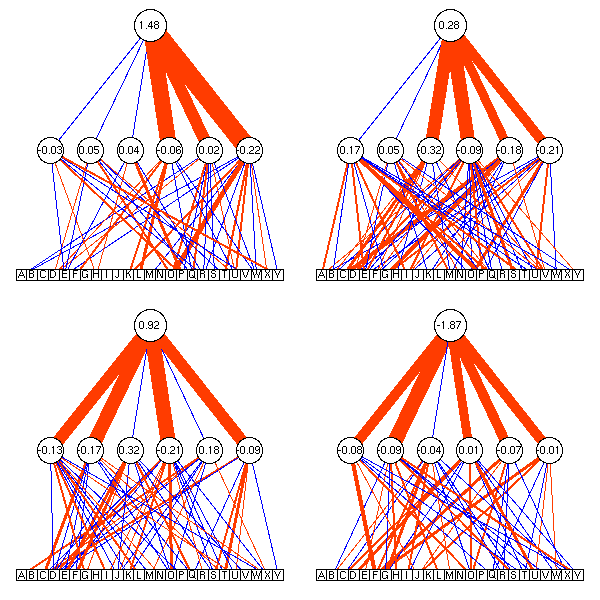

library(nnet)

nnant1 <- nnet(

colony ~ ., data = dlog, size = 4, rang = 0.1,

decay = 1.0e-4, maxit = 10000

)

print(table(

dlog$colony,

predict(nnant1, dlog, type = "class")

))

# 結果

Atsuta Hoshioki Ishikari Jozankei Oshoro Shinkawa Tarukawa

Atsuta 10 0 0 0 0 0 0

Hoshioki 0 10 0 0 0 0 0

Ishikari 0 0 10 0 0 0 0

Jozankei 0 0 0 9 0 1 0

Oshoro 0 0 0 0 10 0 0

Shinkawa 0 0 0 0 0 10 0

Tarukawa 0 0 0 0 0 0 10

size)

が 3, 4 個ぐらいあれば

「与えられたデータ全体を区別する」

だけなら 99% ぐらいはうまくできます,

と.

v.training <- c(sapply(

1:7, function(i) (i - 1) * 10 + sort(sample(1:10, 5))

))

nnant2 <- nnet(

colony ~ ., data = dlog, subset = v.training,

size = 12, rang = 0.1, decay = 5.0e-4, maxit = 10000

)

print(table(

dlog$colony[-v.training],

predict(nnant2, dlog[-v.training,], type = "class")

))

# 結果

Atsuta Hoshioki Ishikari Jozankei Oshoro Shinkawa Tarukawa

Atsuta 4 0 0 1 0 0 0

Hoshioki 0 1 0 2 1 1 0

Ishikari 0 0 2 0 2 0 1

Jozankei 0 0 0 2 0 3 0

Oshoro 0 1 0 0 3 1 0

Shinkawa 0 0 0 1 2 2 0

Tarukawa 1 1 0 0 1 1 1

library(nnet)

による炭化水素データ解析のつづき,

じつは同 package の multinom()

(多項 logistic 回帰)

でも同様に推定できるとわかった.

> fit0 <- multinom(colony ~ ., data = dlog)

> fit0

all:

multinom(formula = colony ~ ., data = dlog)

Coefficients:

(Intercept) A B C D E F G

Hoshioki -160.787 93.495 155.25 -347.8654 -22.081 -194.3546 74.185 -169.080

Ishikari -20.039 -63.042 -244.37 -403.2446 -371.311 -77.1832 526.722 279.371

Jozankei -133.633 168.490 -200.43 68.1970 -314.438 -261.4539 -167.454 -42.431

Oshoro 193.391 -16.787 -116.28 6.6953 21.332 -254.0034 -313.117 88.331

Shinkawa -25.612 120.607 173.06 -110.2501 57.424 3.5852 -263.726 -57.633

Tarukawa -146.064 -23.492 -267.25 -82.8609 249.269 -61.7068 214.712 -147.946

H I J K L M N O

Hoshioki 7.670 388.5743 -3.9029 -304.827 -233.90818 616.454 192.311 -12.395

Ishikari -151.814 -491.3550 301.3444 -41.869 345.57834 126.962 -58.226 115.736

Jozankei 447.592 3.2086 60.5417 -74.409 -148.12248 89.806 258.123 131.966

Oshoro -98.285 223.2290 159.5395 187.517 -0.19016 329.265 166.029 78.323

Shinkawa -205.379 74.1548 -19.9271 184.362 276.70534 -101.728 29.297 -67.805

Tarukawa -85.172 -256.0845 40.4551 328.460 -50.73650 48.469 138.853 -79.403

P Q R S T U V W

Hoshioki 186.531 116.7819 -13.252 -203.153 -90.1263 125.86 -252.2161 -111.3959

Ishikari 216.796 1.2474 111.223 216.794 104.7930 -229.66 147.5471 -4.2782

Jozankei 43.812 -181.9078 -118.064 216.945 336.6963 -162.95 67.4382 40.3054

Oshoro -185.117 50.8535 36.150 -200.943 -135.1985 224.57 -155.1527 -198.7463

Shinkawa -104.847 9.7351 378.913 22.425 62.7400 293.75 -308.1354 -9.0895

Tarukawa 4.112 308.4419 311.307 -175.804 9.7507 -172.23 3.0234 -91.7194

X Y

Hoshioki 58.695 -47.898

Ishikari -187.447 -213.472

Jozankei -60.082 -128.031

Oshoro 15.324 -16.013

Shinkawa -415.227 -11.925

Tarukawa 21.964 -204.938

Residual Deviance: 2.7726

AIC: 314.77

stepAIC() によるモデル選択までできる,

と.

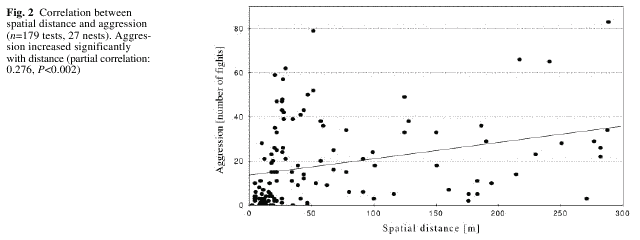

25 箇所のガスクロマトグラフィーによる

ピークのうち判別に使える部分を

「選んで」いる,

という

……

> stepAIC(fit0)

...

Call:

multinom(formula = colony ~ D + G + K + M + N + O + P + Q + R +

S + U + V + W, data = dlog)

Coefficients:

(Intercept) D G K M N O P Q

Hoshioki -35802.0 4378.6 -20031.6 -30456.7 58773 20507 -1527.9 -4944.70 9888.7

Ishikari -5264.0 -59267.7 51292.0 -17213.2 15649 33978 10244.8 -282.82 -15747.8

Jozankei 1298.8 -48528.5 28208.0 -5714.3 33506 32659 6243.7 -19584.80 -18697.0

Oshoro 30241.9 -9374.9 -5951.1 -10068.7 31545 26913 9651.4 -11372.27 4636.0

Shinkawa -25116.1 9907.5 -7978.4 -7677.5 19680 14561 -12884.9 -4997.35 17466.9

Tarukawa -15535.1 20752.2 -40435.8 7213.4 13204 13532 -16695.3 8848.42 23986.5

R S U V W

Hoshioki 22094.6 -19065.5 34809.459 -48162.57 -24981

Ishikari -3067.5 12265.3 94.521 -7033.05 -15551

Jozankei 8837.3 -2067.4 7410.352 -3107.35 -15260

Oshoro 1107.5 -16335.5 2408.336 -5926.06 -19343

Shinkawa 49170.6 -36876.6 32909.337 -58468.25 -16706

Tarukawa 23580.8 -22431.6 -12271.873 -489.45 -13283

Residual Deviance: 2.7726

AIC: 170.77

multinom()

のコードみてみると

内部で nnet( ..., skip = T, size = 0, ...)

つまり中間層 (隠れ層) の個数をゼロにして入力層と出力層を直結している

(skip-layer connection),

とわかった.

モデル選択する前後でどちらも「正答」率 95% 以上

(ということで Residual Deviance がだいたい同じ値になっている).

library(nnet)

の nnet()

のことを「パーセプトロン」と書いたけど,

Ripley 先生の説明よんでるうちにこれって

(一番単純な)

パーセプトロンではない,

という気がしてきた.

そのあたりを検証してみる実験.

(隠れ層-出力層間の結線加重だけを調節する)

パーセプトロンが苦手とする

XOR 問題

をとかせてみる.

> (d <- data.frame(z = c(0, 1, 1, 0), x = c(0, 0, 1, 1), y = c(0, 1, 0, 1)))

z x y

1 0 0 0

2 1 0 1

3 1 1 0

4 0 1 1

> nn <- nnet(z ~ x + y, data = d, size = 4)

# weights: 17

initial value 1.130982

...

final value 0.000059

converged

> nn$fitted.value

[,1]

1 0.00021232

2 0.99940975

3 0.99235554

4 0.00076111

……

うまく学習してるぢゃん.

ということで隠れ層-出力層間の結線加重だけを調節する

パーセプトロンではない,

と示された.

とはいえ,

バックプロパゲイション使ってるわけでもないし.

?nnet

によれば optim( ..., method = "BFGS")

使ってるらしい.

nnet() も単なる多層パーセプトロンと考えればよいのかな?

nnet()

はかなり難しい問題もあつかいうる,

とわかった.

なかなかすばらしいですね.

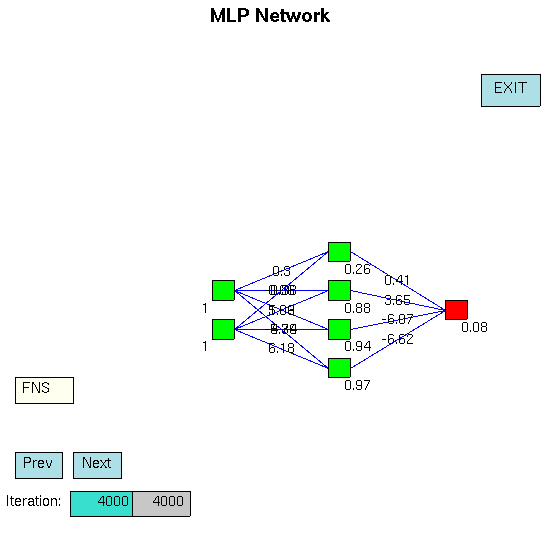

library(neural)

ってのもあるなあ

……

こういうヘンな GUI つき.

library(AMORE)

ってのもあるんだけど,

なんだかこれはややこしい

……

library(nnet)

による学習 & 試験をくりかえした結果,

「とりあえず,

まあ,

沖縄発表はコレで OK だろ」

な結果が得られた

……

えーと正確に言えば,

もうちょい定量的にやる必要あるんだけど,

基本アイデアはおそらくまちがっていない,

という見とおしが得られた.

mate (味方):

Hoshioki コロニー 10 個体ぶんのデータの各

25 ピークに「ちょっとだけ」正規乱数でゴミを

追加した「ニセ」 Hoshioki アリデータ

enemy (敵):

mate

と同じように作るんだけど,

もっと正規乱数ゴミが大きい

(乱れたパターン)

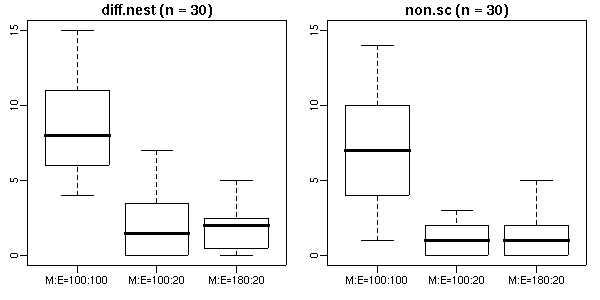

same.nest: Hoshioki colony の 10 個体,

つまり Hoshioki アリからみて同巣のアリ

diff.nest: 石狩浜 supercolony の他の 3 巣

の 30 個体

non.sc: 石狩浜 supercolony 外の 3 巣

の 30 個体

mate : enemy = 180 : 20

でやった場合,

つまり石狩浜的な状況.

これは一例にすぎないんだけど,

たとえばこういう結果がよく出る.

# 訓練の結果

enemy mate

enemy 20 0

mate 0 180

# 試験

enemy mate

same.nest 0 10

diff.nest 0 30

non.sc 1 29

つまり他巣・SC 外のアリをみても mate

だと思ってしまう,

と.

mate : enemy = 100 : 100

でやった場合,

つまり (いわば) Jozankei な状況.

これも一例にすぎないんだけど

……

# 訓練の結果

enemy mate

enemy 100 0

mate 0 100

# 試験

enemy mate

same.nest 0 10

diff.nest 11 19

non.sc 12 18

つまり他巣・SC 外のアリをみたときに enemy

だと判定する確率が高くなるんでは,

と.

enemy が多いか少ないか)

で「判定の甘い辛い」は変わるだろう,

と.

diff.nest)

と外 (non.sc)

がまったく区別できてない,

ということだ.

このあたりは城所さん秘蔵 (?)

データを使うとよいのかもしれませんなぁ

……

まあ,

こんなのは「沖縄」後でもよさそうだし.

enemy

をもっとでたらめなパターンにすると,

enemy に包囲された状況であっても

「エゾアカヤマアリなら誰でもトモダチさ!」

となってしまうようで.

Unfortunately, I am not familiar with the XXX methods used in the paper at all. I would suggest that Dr. XXX (xxx@xxx.ac.jp) is one of the experts at the ...

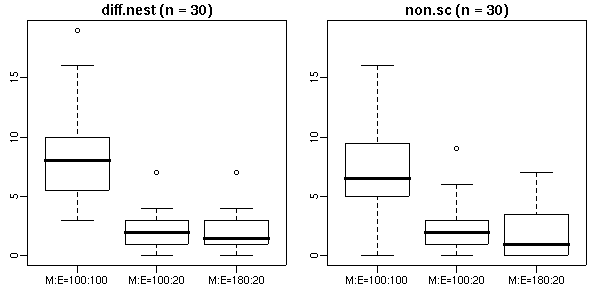

mate (味方):

Hoshioki コロニー 10 個体ぶんのデータの各

25 ピークに「ちょっとだけ」正規乱数でゴミを

追加した「ニセ」 Hoshioki アリデータ

enemy (敵):

mate

と同じように作るんだけど,

もっと正規乱数ゴミが大きい

(乱れたパターン)

mate

と応答する.

で,

Hoshioki ではない石狩浜 SC 内の他コロニー (diff.nest)

と SC 外コロニー (non.sc)

それぞれ 30 個体のデータを「触角でさわらせ」て,

enemy だと認識する回数をカウントしてみたところ

……

enemy

あつかいする確率が高まり,

「敵の少ない環境 (友 100 敵 20,または友 180 敵 20)」

だとその確率が下がる,

と.

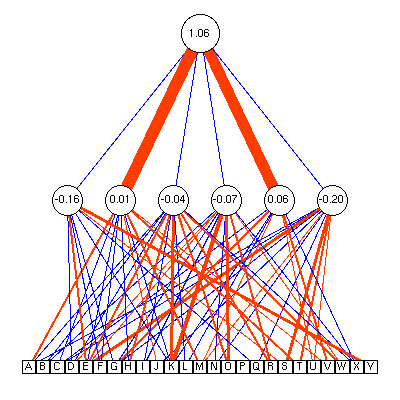

M:E=180:20,

つまり「敵の少ない」環境で教育されたもの.

現実のアリとは逆に,

このアリは mate かどうか,

を output する

(これはまあどっちでもいいんだが).

enemy 判別グラフ),

結線加重は融通無碍,

というか.

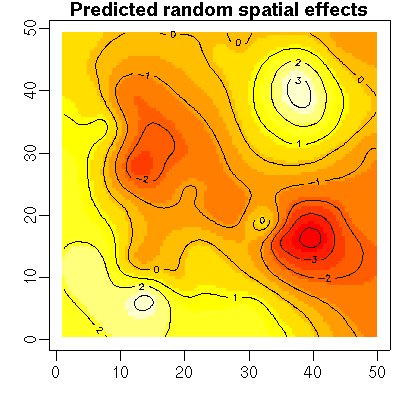

example(lmer) に

登場する)

(Days | Subject)

(0 + Days | Subject)

(1 + Days | Subject)

あり,

しかも両者の random effects の「事前分布」が独立な正規分布ではなく,

相関のある正規分布つまり多変量正規分布 (この場合は二変量正規分布)

ということだ.

Lmer 雑

を修正.

ranef()

で random efects をチェックせよ,

と.

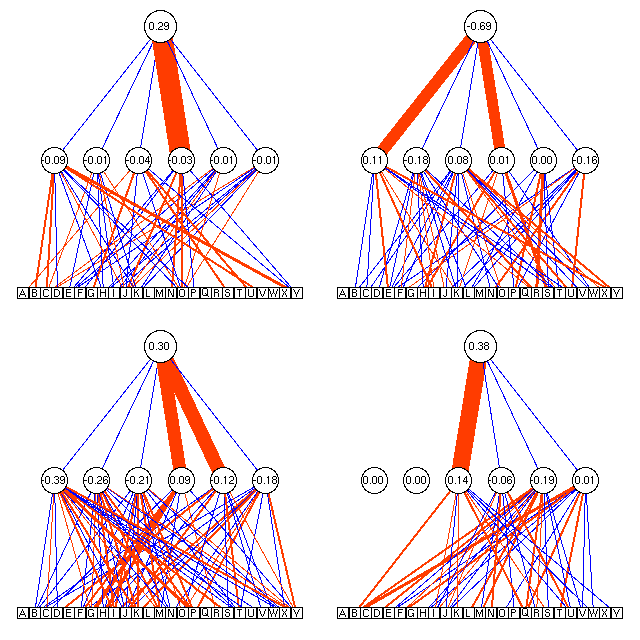

nnet()

では「テキかどうか」を答えさせるようにしてみる

(昨日のは「ミカタかどうか」を答えさせていた)

\documentclass{seminar}

のせい,

かも.

(略) お手元のET-FSWH8S2に関しましては、製品に問題があるかどうかの判断をおこないた いため、一度、検査・修理させていただきたいと思います。恐れ入ります が、以下のものを同封していただき、下記の修理宛に宅配便でお送りくださいますよう お願いいたします。 【同封するもの】 1.問い合わせ番号1301817と記入したメモ 必ず問い合わせ番号1301817をメモにお書きの上、箱の中に同封して ください。 2.保証書(コピーではなく原本をお願いいたします。) 保証期間内の場合は、保証書に不備がないことをご確認ください。 ※販売店印等がない場合は、ご購入の履歴となる証明書(レシート・ 納品書・インターネットでの購入の場合は発送のメールなど)を同梱 してください。 <宛 先> (略) (発送費用については、修理品を返送する際の費用は当社にて負担させていただきます ので、恐れ入りますが修理品送付時はお客様ご負担にてお願いいたします。) (略)

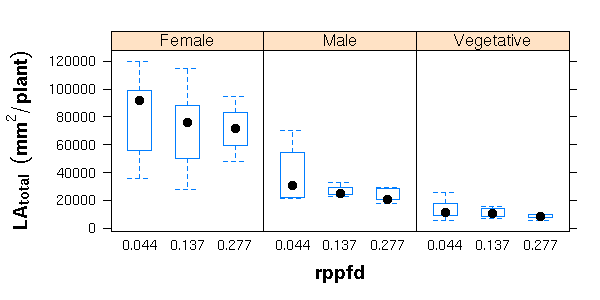

library(lattice)

の bwplot()

におしつけてみるこころみ.

par.settings

で設定できること一覧は

names(trellis.par.get())

や

show.settings()

参照.

あるいは

help(trellis.par.get)

に示されているやりかたも参照.

library(lattice)

d <- read.csv("data.csv")

print(bwplot(

total.leaf.area ~ I(as.factor(rppfd)) | sex,

data = d,

layout = c(3, 1),

xlab = expression(bold("rppfd")),

ylab = expression(bold("LA"[total]~~(mm^2/plant))),

par.settings = list(

par.xlab.text = list(cex = 1.2),

par.ylab.text = list(cex = 1.2),

layout.widths = list(left.padding = 0, right.padding = 0),

layout.heights = list(top.padding = 0, bottom.padding = 0)

)

))

\documentclass{seminar}

ファイルに \input{}

や \includegraphics{}

する作業.

スケイリング変換とかけっこうたいへん.

example().

これは Not run

状態になってるので,

こぴぺによる実行が必要.

また library(MBA)

なる B-spline package もインストールしとかないと,

等高線を描いてくれない.